Le mois de janvier 2026 a été marqué en RDC par une série de contenus trompeurs très différents les uns des autres, mais qui disent tous quelque chose de l’évolution de la désinformation. Ce ne sont plus seulement de fausses rumeurs ou des intox grossières. Ce sont désormais des contenus travaillés, scénarisés, parfois technologiquement sophistiqués, qui s’insèrent dans l’actualité politique, sécuritaire ou sociale du pays.

Des deepfakes politiques plus crédibles que jamais

L’exemple le plus marquant reste la vidéo attribuant à Donald Trump un discours sur la RDC lors du Forum économique mondial de Davos. Les images sont authentiques : le président américain a bien pris la parole à Davos le 21 janvier. Mais la voix, elle, a été générée artificiellement.

Le procédé est simple et redoutablement efficace : utiliser un événement réel, une figure internationale crédible et un décor officiel, puis y greffer un message fabriqué. Résultat : beaucoup d’internautes ont cru que Donald Trump s’adressait directement aux Congolais, appelant à une mobilisation contre le régime de Félix Tshisekedi.

Or, la vérification du discours intégral montre que la RDC et l’Afrique n’y sont jamais mentionnées. Les outils de détection confirment que l’audio a été manipulé. On est ici face à une désinformation de nouvelle génération : le faux ne remplace plus le vrai, il s’y greffe.

Recycler de vieilles images pour créer de faux événements

Autre méthode très utilisée en janvier : ressortir des images anciennes pour leur faire dire autre chose. La photo montrant Félix Tshisekedi et Joseph Kabila, présentée comme une rencontre à Lomé en janvier 2026, en est un bon exemple.

L’image est authentique, mais elle date de janvier 2019 et a été prise au Palais de la Nation à Kinshasa. Elle a déjà illustré des articles sur les tensions entre le FCC et le CACH après les élections de 2018. Aucun média crédible n’a évoqué une rencontre entre les deux hommes à Lomé cette année.

Ce type de désinformation joue sur une corde sensible : le désir de dialogue, de réconciliation ou de retournement politique. Une photo vraie, sortie de son contexte, suffit à fabriquer un événement inexistant.

Jouer sur la peur : fausses alertes et scénarios catastrophes

Janvier a aussi été marqué par des fausses alertes sécuritaires ou environnementales, notamment autour d’une prétendue éruption du volcan Nyiragongo à Goma. Une vidéo diffusée sur TikTok montrait un faux journaliste annonçant une catastrophe imminente, appelant la population à fuir.

Là encore, les faits sont clairs : aucune éruption du Nyiragongo n’a eu lieu. L’activité observée concernait le Nyamulagira, sans danger pour la ville. L’Observatoire volcanologique de Goma a démenti formellement. Les analyses techniques indiquent que la vidéo a été générée par intelligence artificielle.

Ce type de contenu s’appuie sur la mémoire collective des drames passés, notamment les éruptions de 2002 et 2021, pour provoquer une réaction émotionnelle immédiate.

La guerre amplifiée par les réseaux sociaux

Autre tendance : les fausses annonces de prises de villes par l’AFC/M23, comme Lubumbashi ou Kalemie. Ces informations, largement relayées, n’ont été confirmées par aucune source officielle, aucun média, ni même par les canaux de communication du mouvement armé.

Ici, la désinformation ne crée pas un événement, elle exagère un conflit réel, en étendant fictivement le théâtre des opérations. L’objectif semble clair : semer l’inquiétude, donner l’impression d’une avancée généralisée et fragiliser le sentiment de stabilité.

Même le sport n’est plus épargné

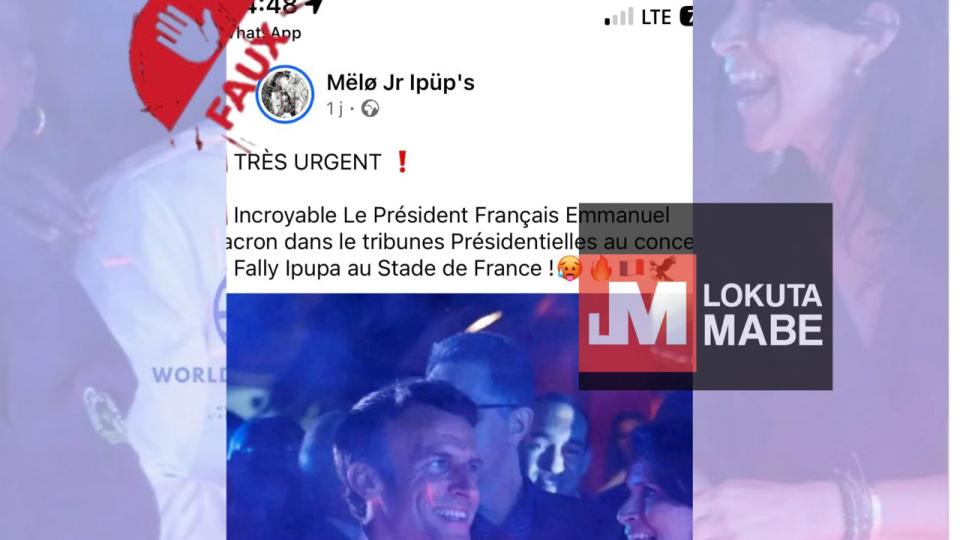

Enfin, la Coupe d’Afrique des nations a servi de terrain à une désinformation plus « légère » en apparence, mais tout aussi révélatrice : propos inventés d’entraîneurs, vidéos de vestiaires générées par IA, images truquées de supporters.

Ces contenus circulent vite, font sourire parfois, mais participent à une banalisation du faux. Ils montrent que la désinformation ne se limite plus aux crises majeures : elle s’infiltre aussi dans les moments de divertissement et d’émotion collective.

Ce que révèle janvier

Ce que montrent tous ces cas, c’est une évolution nette : la désinformation devient plus crédible visuellement, plus émotionnelle, plus difficile à détecter à l’œil nu. L’intelligence artificielle n’est pas toujours au cœur du processus, mais elle en est désormais un accélérateur majeur. Face à cette réalité, une constante demeure : les contenus faux circulent plus vite que leur démenti. Et plus ils s’appuient sur des éléments vrais (une image réelle, un événement réel, une voix familière), plus ils trouvent un écho.